Rising Seer — KI-nativer Fractional CTO

Fractional CTO für eine KI-native Astrologie-Plattform — Verantwortung für Infrastruktur, Tooling und Auslieferung bis zum Launch.

risingseer.comTechnologies Used

Key Features

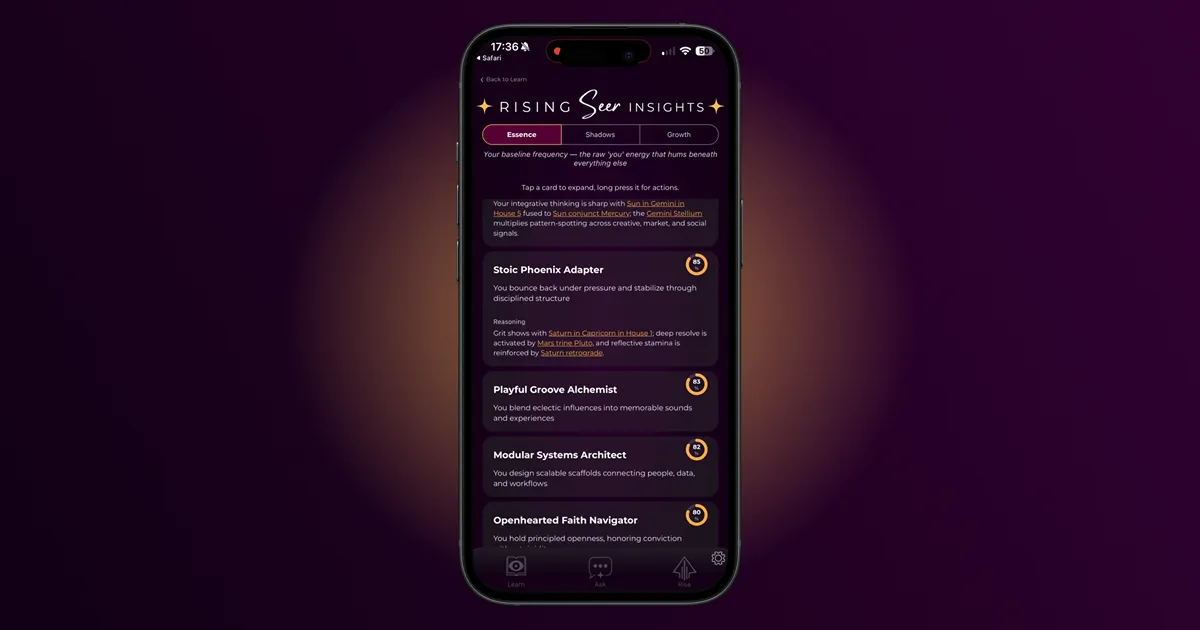

Was Rising Seer ist

Rising Seer ist eine Mobile-first-Astrologie-Plattform, die ausgefeilte UX mit tiefem astrologischem Reasoning verbindet — angetrieben von einer Multi-Agent-KI-Pipeline. Ich bin als Fractional CTO eingestiegen, kurz vor dem Launch: Priority-Engagement auf monatlichem Retainer, täglicher Standup-Takt, End-to-End-Verantwortung für die technische Ausrichtung.

Stack: Expo / React Native im Mobile-Bereich, Python / FastAPI im Backend mit einem Flask-Microservice-Cluster hinter einem Gateway, Multi-Provider-LLM-Pipeline (OpenAI + Gemini) mit hybrider Retrieval-Strategie (Pinecone + BM25), Firebase + GCP, Terraform-IaC.

Meine Rolle — die vier Säulen

Leadership-Engagements bei AI-Native Works laufen auf vier Säulen. In der Praxis wird dieses Framework bei Rising Seer sichtbar.

Roadmap & Strategie

Technische Richtung im Einklang mit Geschäftszielen. Was gebaut wird, in welcher Reihenfolge und warum.

- End-to-End Codebase-Review — Architektur, KI-Pipeline, Datenmodell, Sicherheit, CI/CD-Lücken, Skalierungsgrenzen. Das daraus entstandene Risikoregister und Workload-Assessment bildeten die Grundlage für alle weiteren Entscheidungen.

- Feature-Scoping für zwei große Initiativen (Context Knowledge Graph, RAG-Retrieval-Überarbeitung) — Design-Dokumente in Projekte, Milestones und Tickets heruntergebrochen, gegen die das Team liefern konnte.

- Teamzusammensetzung und Sizing-Strategie für einen KI-beschleunigten Workflow — bewusst klein und hebelorientiert statt kopfzahlorientiert.

Architektur & Tooling

Systemdesign, Technologieauswahl, KI-Integrationsstrategie. Die Entscheidungen, die bestimmen, ob ein Produkt skaliert oder stagniert.

- Staging-Umgebung von Grund auf aufgebaut — eigene Cloud-Run-Services, eigene Firestore-Instanz, eigener Pinecone-Namespace.

- Tag-basierte Production-Deploy-Pipeline mit GitHub-Environment-Approval-Gates, kombiniert mit Staging-on-Merge für schnelle Iteration.

- PostHog-Feature-Flag-Setup als Fundament für ein Flagged-off-on-main-Pattern — keine Branch-Handoffs mehr zwischen Entwicklern.

- Single-Source-of-Truth-Versionsarchitektur zur Auflösung der Mehrdeutigkeit zwischen Mobile-OTA und Native-Builds.

Developer Enablement

Einführung KI-nativer Praktiken im bestehenden Team. Nicht Entwickler ersetzen — sie drastisch effektiver machen.

- Migration von GitHub Issues nach Linear — 200+ Issues mit intakten Abhängigkeiten übernommen, plus eine eigene Linear-Integration für AI-Coding-Agents zur Reduktion des Token-Verbrauchs.

- Framework für Onboarding und technische Evaluierung des neuen Full-Stack-Entwicklers.

- Täglicher Standup und PR-Review-Takt — der operative Herzschlag, während die Velocity anzieht.

Output-Validierung

Qualitätstore, Architektur-Review, Produktionsreife. Sicherstellen, dass das Ausgelieferte produktionstauglich ist.

- Strukturelles PR-Review beim Rollout des hybriden RAG-Retrievals — Architekturdefekte vor dem Merge nach main abgefangen.

- PR-Review quer durchs Team als feste Praxis — Code-Qualitätslatte hoch gehalten, auch wenn die KI-unterstützte Velocity steigt.

- Schließen von CI-Gating-Lücken: unterdrückte pytest-Fehler sichtbar gemacht, Firestore-Composite-Indizes zwischen Test- und Prod-Umgebung angeglichen.

Umfang

- Monorepo mit Mobile, Python-Backends, Multi-Agent-KI-Pipeline und Terraform-Infrastruktur

- Multi-Provider-LLM-Orchestrierung mit hybrider Retrieval-Strategie, hedged Calls und maßgeschneidertem Context-Assembly

- Fractional-Engagement mit monatlichem Retainer, Priority-Verfügbarkeit, täglicher Standup-Takt

- Kleines Team: Gründer, ein Full-Stack-Entwickler, eine QA-Analystin, KI-beschleunigtes Liefermodell

Aktuelle Fortschritte und Laufendes

- Teamzusammensetzung neu aufgestellt — Misalignment eines Contractors noch vor dem Launch erkannt und bereinigt; Neuaufstellung auf ein kleineres, hebelstärkeres Team

- Staging-Umgebung und tag-basierte Production-Pipeline ausgeliefert

- Terraform-Coverage-Audit abgeschlossen, Infrastrukturlücken geschlossen

- Single-Source-of-Truth-Versionsarchitektur im Review

- Linear-Workspace-Migration und vollständige Backlog-Restrukturierung

- Codebase-Review abgeliefert

TIP

Warum sich diese Art von Engagement auszahlt

Solo- und Small-Team-Founder merken oft erst, dass ein Contractor unterperformt, wenn sich der Schaden bereits in Monaten verbrannter Runway misst. Ein eingebetteter KI-nativer CTO fängt genau solche Probleme ab, und die Kostendifferenz einer einzigen Korrektur deckt oft das gesamte Engagement um ein Vielfaches. Rising Seer hat diese Rechnung bereits bestätigt.